具体描述

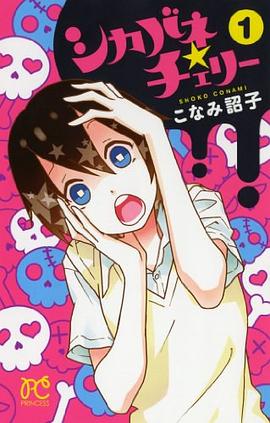

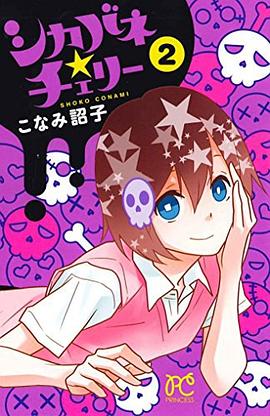

「チェリースープ」の効き目が永遠でないことを知り、大いにショックを受ける美雨は、死ぬ前に大好きな桃野くんに告白することを決意。しかし、幼なじみの羽瑠に遮られ…! ? ヒミツのアンデッドラブポーション、第2巻! !

作者简介

目录信息

读后感

评分

评分

评分

评分

用户评价

这本书的装帧细节处理得相当到位,即使是书脊部分的印刷也丝毫没有马虎,字体大小恰到好处,整体风格也与封面设计保持了一致。我特别喜欢它在细节上所展现出的用心,比如它采用的应该是某种特殊的装订方式,翻阅起来非常顺畅,不会轻易出现书页脱落的情况,这对于我这种经常需要在通勤路上阅读的人来说,是非常重要的考量。此外,它在纸张的选择上也很有讲究,不是那种廉价的、泛黄的纸张,而是带着一种温润的触感,即使长时间阅读也不会觉得眼睛疲劳。封面的设计更是我选择这本书的重要原因之一,那种略带暗黑系的色彩搭配,以及画面中看似破碎却又充满象征意义的元素,都让我对故事内容产生了无限的遐想。我总觉得,一个精心设计的封面,往往能够最直观地反映出作者想要传达的核心情绪或者故事基调,而这本书的封面,无疑成功地勾起了我的探知欲,让我迫不及待地想要翻开它,去感受作者笔下的世界。

评分这本书的封面设计可以说是非常吸引眼球,它融合了某种哥特式的暗黑美学和少女漫画的明亮元素,形成了一种强烈的视觉对比。我注意到封面上樱桃的图案,以及背后一些破碎的、像是玻璃或者镜子一样的碎片,这种意象的组合,立刻勾起了我的好奇心,让我忍不住想要去探究故事的内涵。我通常会在实体书店里花费很长时间去浏览书籍,而这本书,凭借其独特的封面风格,在众多书籍中脱颖而出,成功地引起了我的注意。我喜欢那些能够在视觉上就传达出某种故事氛围的书籍,因为我觉得,好的封面设计,就像是一个无声的引子,能够迅速抓住读者的注意力,并让他们对书中的内容产生期待。这本书的封面,无疑就做到了这一点,它让我对即将展开的故事,充满了无限的想象和渴望。

评分这本书的封面艺术感非常强,色彩的运用既大胆又内敛,形成了一种独特的视觉张力。我尤其欣赏它在构图上的巧思,那种不对称的美感,以及留白的处理,都显得恰到好处,不会显得拥挤,反而能引导读者的视线,去捕捉画面中的每一个细节。当我在书店里看到它的时候,第一眼就被它吸引住了,那种复杂却又和谐的画面,让我忍不住想要深入了解背后的故事。我想,作者在设计这个封面的时候,一定花费了不少心思,它不仅仅是一个简单的装饰,更像是故事的一个浓缩的预告片,用视觉语言传递着某种情绪和氛围。我通常会把封面作为判断一本书是否值得购买的重要标准之一,因为我觉得一个好的封面,能够极大地提升阅读的愉悦感,并且在我心中为这本书留下一个深刻的印象。这本书的封面,无疑就做到了这一点,它让我对接下来的阅读充满了期待。

评分拿到这本书时,我立刻被它精致的装帧所吸引。封面的设计风格独树一帜,色彩的搭配极具冲击力,给人一种既熟悉又陌生的感觉。我特别留意到封面上的一些细微之处,例如光影的处理,以及图案的纹理,都显得非常考究,显示出出版方在制作上的用心。书的尺寸拿在手里大小适中,方便携带,纸张的质感也很好,印刷清晰,阅读起来非常舒服。我选择这本书,很大程度上是受到了封面设计的影响,它所传达出的某种神秘、青春又带着一丝忧伤的气息,深深地打动了我,让我对书中可能蕴含的故事产生了浓厚的兴趣。我喜欢那些封面能够引发读者想象力的书籍,而这本书无疑做到了这一点,它让我充满了想要一探究竟的冲动,期待它能带给我一个精彩绝伦的阅读体验。

评分这本封面设计给我一种复古又充满神秘感的视觉冲击,深色的背景衬托着樱桃的鲜艳,还有些许破碎的痕迹,仿佛预示着某种不寻常的故事。拿到手的时候,纸张的质感也相当不错,很有厚重感,翻开第一页,印刷清晰,文字大小适中,阅读起来非常舒适。我一直对带有“星号”或者“符号”的标题很感兴趣,总觉得里面藏着一些不为人知的信息,或者代表着某种特殊的象征意义,尤其是“シカバネ”这个词,本身就带着一种难以言喻的压抑感,而“チェリー”则又带来了青春、美好甚至有些禁忌的联想。这两者结合在一起,构成了强烈的反差,让我在阅读之前就充满了好奇和期待,想要去探究作者究竟想要通过这个标题传达怎样的世界观和故事内核。我通常会根据封面和标题来判断一本书是否是我的菜,而这本书无疑瞬间就抓住了我的眼球,让我迫不及待地想知道它会带我进入一个怎样的故事,是关于成长,还是关于失落,亦或是关于某种奇幻的冒险,这一切都充满了未知的吸引力。

评分 评分 评分 评分 评分相关图书

本站所有内容均为互联网搜索引擎提供的公开搜索信息,本站不存储任何数据与内容,任何内容与数据均与本站无关,如有需要请联系相关搜索引擎包括但不限于百度,google,bing,sogou 等

© 2026 book.quotespace.org All Rights Reserved. 小美书屋 版权所有