具体描述

好的,这里有一份针对一本假设名称为《流行英语900句》的书籍的不包含该书内容的详细图书简介。这份简介将聚焦于其他主题和内容,力求详尽且自然流畅。 书籍名称:《深度学习与神经网络:从理论基石到前沿应用》 作者: [此处留空,模拟真实作者署名] 出版社: [此处留空,模拟真实出版社信息] 内容简介 在这个信息爆炸、技术迭代日新月异的时代,人工智能(AI)已经从科幻概念转变为驱动社会变革的核心力量。而在AI浪潮中,深度学习无疑是最引人瞩目的核心技术。本书《深度学习与神经网络:从理论基石到前沿应用》旨在为渴望深入理解和掌握现代人工智能核心技术的读者,提供一条从基础原理到复杂实践的完整学习路径。 本书的创作初衷,是为了弥补当前市场上许多入门级教材过于概念化、而专业著作又过于晦涩的鸿沟。我们相信,真正的理解源于对底层数学原理的清晰把握,以及对实际工程实现的熟练驾驭。因此,本书结构严谨,内容涵盖了神经网络的经典架构、现代优化策略,直至当前最热门的生成模型和强化学习的最新进展。 --- 第一部分:基础理论与数学构建 (Foundations and Mathematical Construction) 本部分将打下坚实的理论基础,确保读者不仅知道“如何做”,更明白“为什么能做”。 第一章:引言:人工智能、机器学习与深度学习的演进 本章首先描绘了AI领域的宏观图景,界定了机器学习、统计学和深度学习之间的关系。重点阐述了“深层结构”的出现如何克服了传统浅层模型的局限性,并回顾了早期感知机到反向传播算法的历史性突破。 第二章:线性代数与概率论的复习与重构 深度学习的语言是数学。本章精炼地回顾了构建神经网络所必需的线性代数知识(矩阵分解、特征值、奇异值)和概率论基础(贝叶斯定理、最大似然估计)。不同于纯数学教材,本章的内容全部围绕其在数据表示和模型推断中的具体应用展开。 第三章:单层感知机与激活函数的精细剖析 从最基础的构建单元——感知机(Perceptron)开始,逐步引入Sigmoid、Tanh,以及现代网络中占主导地位的ReLU及其变体(Leaky ReLU, ELU)。我们不仅分析了这些函数的导数特性,还深入讨论了它们如何影响梯度流动和模型的表达能力。 第四章:反向传播算法的深度剖析与链式法则的工程实现 反向传播(Backpropagation)是深度学习的引擎。本章通过清晰的数学推导和伪代码演示,详细展示了梯度如何通过网络层层回传。同时,我们将探讨不同框架(如TensorFlow/PyTorch)底层如何高效地实现这一过程。 --- 第二部分:核心网络架构与优化策略 (Core Architectures and Optimization Strategies) 在掌握了基础构建块后,本部分将转向构建具有实际解决能力的复杂网络模型。 第五章:多层前馈网络(FNN)与正则化技术 FNN是理解更复杂网络的基础。本章重点讨论了网络层数的增加带来的挑战——过拟合。我们将详细介绍Dropout、L1/L2正则化、早停法(Early Stopping)等关键正则化手段的原理及其在实际训练中的权衡。 第六章:卷积神经网络(CNN)的几何洞察 CNN是处理图像和空间数据的核心工具。本章不仅介绍了卷积层、池化层和感受野的概念,更深入探讨了经典网络如LeNet、AlexNet、VGG直至ResNet(残差连接)的演进逻辑。特别地,我们将分析残差连接如何解决了深度网络中的梯度消失问题。 第七章:循环神经网络(RNN)的时序建模 对于文本、语音等序列数据,RNN是不可或缺的。本章从基础RNN讲起,着重分析了标准RNN在处理长距离依赖时的困境。随后,我们将详细解析长短期记忆网络(LSTM)和门控循环单元(GRU)的内部结构和门控机制。 第八章:优化器的革新:从SGD到自适应学习率 训练的效率和稳定性直接依赖于优化器的选择。本章全面对比了随机梯度下降(SGD)及其动量法(Momentum),并详细解释了Adam、RMSProp等自适应学习率方法的内在机制,为读者提供何时选用何种优化器的实用指导。 --- 第三部分:前沿探索与高级模型 (Frontier Exploration and Advanced Models) 本部分将带领读者进入当前AI研究的热点领域,展示深度学习的巨大潜力。 第九章:注意力机制与Transformer的革命 注意力机制(Attention Mechanism)彻底改变了序列建模的范式。本章将深入讲解自注意力(Self-Attention)的计算过程,并详尽剖析Transformer架构中“编码器-解码器”的设计精妙,以及它如何成为BERT、GPT等大型语言模型(LLM)的基石。 第九章:生成模型:从变分自编码器(VAE)到生成对抗网络(GAN) 本书将详细解析两大主流生成模型的内在工作原理。我们不仅会展示如何训练一个能生成逼真图像的GAN,还会探讨其训练中的不稳定性问题,并介绍WGAN等改进方案。同时,VAE的概率推理框架也将被清晰阐述。 第十一章:深度强化学习(DRL)基础 DRL是赋予机器决策能力的钥匙。本章引入马尔可夫决策过程(MDP),并介绍Q-Learning、Deep Q-Network(DQN)以及策略梯度方法(如REINFORCE、A2C),旨在让读者理解智能体如何在复杂环境中通过试错学习最优策略。 第十二章:模型部署与工程实践的挑战 理论的价值最终体现在落地应用中。本章讨论了模型量化、剪枝、知识蒸馏等模型压缩技术,以适应边缘计算设备的需求。此外,我们还将探讨模型可解释性(XAI)的重要性,帮助工程师和研究人员更好地理解“黑箱”决策过程。 --- 适用读者 本书面向具备一定数学基础(微积分、线性代数初步概念)的计算机科学专业学生、数据科学家、软件工程师,以及希望从基础原理上深入理解和应用现代AI技术的专业人士。本书强调代码实践与理论推导的结合,每章后附有基于Python和主流深度学习框架的实战代码案例。 通过本书的学习,读者将不仅能熟练运用现有的深度学习工具包,更能具备设计、优化和创新新型神经网络结构的能力,从而在快速演进的AI领域中保持领先地位。

作者简介

目录信息

读后感

评分

评分

评分

评分

评分

用户评价

评分

评分

评分

评分

评分

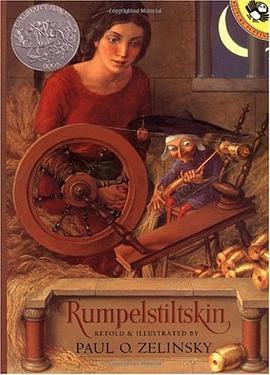

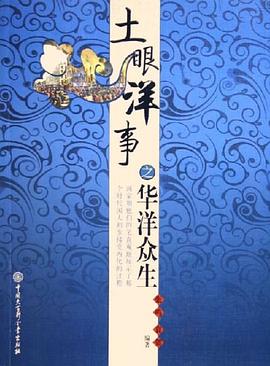

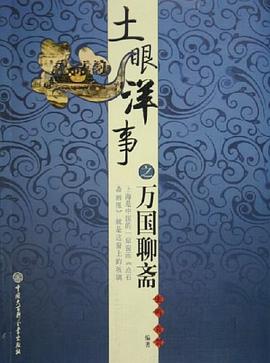

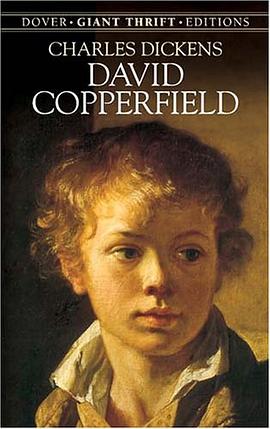

相关图书

本站所有内容均为互联网搜索引擎提供的公开搜索信息,本站不存储任何数据与内容,任何内容与数据均与本站无关,如有需要请联系相关搜索引擎包括但不限于百度,google,bing,sogou 等

© 2026 book.quotespace.org All Rights Reserved. 小美书屋 版权所有